Dans le paysage technologique actuel, l’automatisation par l’intelligence artificielle (IA) soulève d’importantes questions éthiques. Les avancées rapides dans ce domaine offrent des opportunités considérables pour améliorer l’efficacité et la productivité, mais elles posent également des défis liés à l’équité, la transparence et la responsabilité. Alors que les entreprises et les gouvernements commencent à adopter ces technologies, il devient crucial de réfléchir à la manière dont elles peuvent être intégrées de manière responsable dans nos sociétés.

Le potentiel transformateur de l’IA dans différents secteurs, allant de la santé à la finance, est sans précédent, mais il ne doit pas se faire au détriment des valeurs humaines fondamentales. En explorant les implications éthiques de l’automatisation, on constate que cette technologie reflète aussi les contradictions de nos sociétés et la diversité de nos valeurs. L’absence de normes et de cadres éthiques clairs peut avoir des conséquences graves sur l’égalité des droits, la vie privée et la dignité humaine.

Le rôle des algorithmes dans notre société

Les algorithmes sont au cœur de l’automatisation d’IA. Ils déterminent des résultats qui peuvent influencer les vies de millions de personnes. Un exemple marquant est celui des algorithmes utilisés lors des élections, où ils peuvent renforcer des biais existants par la création de bulles de filtres. Ces systèmes recommandent des contenus qui confortent les opinions des utilisateurs, remettant en question la qualité des débats publics. Les algorithmes, en tant qu’entités autonomes, peuvent compromettre la diversité d’opinions et conduire à un discours de plus en plus polarisé.

Pourtant, la question demeure : comment développer des algorithmes qui prolongent l’éthique dans leur fonctionnement ? Il est vital d’envisager des systèmes qui soient non seulement efficaces, mais aussi justes et transparents. Pour que cela soit possible, il est essentiel d’intégrer des valeurs humaines dans la programmation, créant ainsi un alignement entre l’intelligence artificielle et l’éthique humaine.

Les biais algorithmiques : Un problème à surveiller

Un des enjeux majeurs de l’automatisation d’IA est la présence de biais dans les algorithmes. Des études montrent que les modèles d’IA peuvent reproduire des biais préexistants, entraînant des situations d’injustice. Par exemple, lors de la distribution de crédits bancaires, un algorithme peut se baser sur des données historiques qui favorisent certains groupes au détriment d’autres, créant ainsi des inégalités. Ce phénomène est préoccupant, car il remet en question l’égalité des chances et l’accès équitable aux ressources.

Les chercheurs et les développeurs doivent donc porter une attention particulière à la sélection des données utilisées pour entraîner ces systèmes. En garantissant que les données soient représentatives de la diversité de la population, il est possible de minimiser les biais et d’améliorer l’équité des systèmes d’IA. L’éthique dans le développement d’algorithmes n’est pas seulement une mission pour les ingénieurs, mais c’est également une tâche collective qui nécessite la contribution de diverses parties prenantes, y compris des experts en éthique, des sociologues et des représentants communautaires.

Transparence et confiance dans l’IA

La transparence est un autre pilier crucial dans l’éthique de l’automatisation d’IA. Sans une compréhension claire de la façon dont un algorithme fonctionne ou de la manière dont il prend des décisions, la confiance du public s’effondre. Cela peut avoir des répercussions significatives sur l’adoption de l’IA dans des domaines sensibles comme la santé, où des décisions basées sur des diagnostics algorithmiques peuvent affecter des vies. Par conséquent, les entreprises doivent communiquer clairement sur les mécanismes de leur IA et assurer une réputation d’ouverture.

L’intégration de la transparence dans les processus d’IA passe par diverses pratiques, telles que l’élaboration de rapports expliquant les décisions prises par les algorithmes ou la fourniture d’audits indépendants. En impliquant les utilisateurs et les parties prenantes dans ces processus, il est possible de renforcer la confiance dans les systèmes d’IA et de contribuer à un écosystème plus éthique.

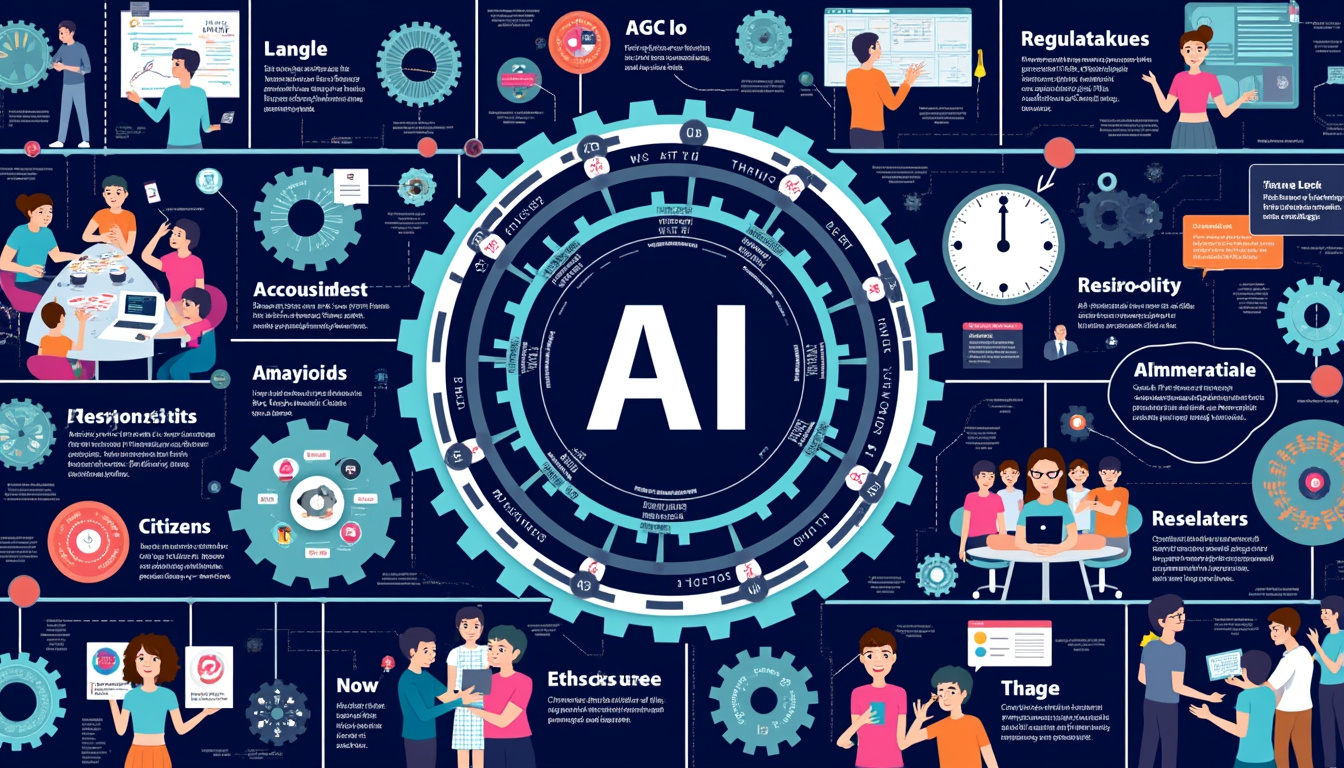

Responsabilité des acteurs de l’IA

La responsabilité est une dimension centrale de l’éthique en matière d’IA, notamment lorsque des décisions prises par des systèmes automatisés ont des conséquences humaines. Qui est responsable si un algorithme cause un préjudice à un individu ou à un groupe ? Cela constitue un défi majeur, car la responsabilité doit être clairement définie pour éviter la dilution des culpabilités. Les cadres de gouvernance doivent établir qui est responsable à chaque étape du processus de développement et de mise en œuvre des systèmes d’IA.

Les utilisateurs, les développeurs et même les décideurs politiques ont un rôle à jouer dans cette responsabilité. Il est essentiel de créer des mécanismes qui garantissent que les décisions d’IA soient examinées et que les erreurs puissent être corrigées. Cela nécessite également la mise en place de réglementations appropriées pour encadrer l’utilisation de ces technologies dans divers secteurs.

La nécessité d’un cadre éthique commun

Les défis éthiques de l’automatisation d’IA soulignent l’importance d’un cadre éthique commun. Alors que les technologies évoluent rapidement, les lois et règlements doivent également s’adapter pour garantir que l’IA soit utilisée de manière éthique. Des initiatives telles que celles mises en place par l’Conseil de l’Europe recherchent à établir des principes éthiques partagés que les développeurs et les entreprises peuvent respecter.

Ces principes doivent aborder des questions telles que la protection des données, la justice sociale, et l’inclusivité. En définissant des standards éthiques clairs, il devient possible de guider le développement de l’IA vers des pratiques qui respectent les droits humains fondamentaux. De cette manière, l’IA peut devenir non seulement un outil d’efficacité, mais également un vecteur d’égalité et de justice sociale.

Les défis futurs de l’IA éthique

À mesure que la technologie continue d’évoluer, il est clair que les défis éthiques entourant l’IA deviendront de plus en plus complexes. Les discussions autour du cadre éthique de l’IA doivent impliquer un dialogue continu entre les différents acteurs, y compris les techniciens, les éthiciens, et la société civile. Il est impératif que les valeurs humaines restent au centre de ces discussions.

Les besoins d’une régulation éthique et efficace en matière d’IA exige une coopération internationale, car les normes dans ce domaine doivent être harmonisées. En parallèle, des initiatives d’apprentissage, de sensibilisation et de formations autour de l’éthique de l’IA doivent être mises en œuvre pour préparer les futurs professionnels. L’éducation éthique doit devenir une partie intégrante de la formation dans le domaine de l’IA afin de préparer les individus à relever ces défis.

Articles connexes

- IA conversationnelle : humaniser vos interactions client a grande echelle

- Former vos équipes à l’IA : parcours, certifications et bonnes pratiques

- Mesurer les résultats de vos projets IA : indicateurs clés et méthode

- Competences IA : former votre equipe pour rester competitif

- Partenariats stratégiques en IA : comment choisir et collaborer avec les bons prestataires